Media90 – Di tengah masifnya penggunaan kecerdasan buatan (AI), isu privasi data tetap menjadi perhatian utama pengguna. ChatGPT, chatbot populer milik OpenAI, sering memunculkan pertanyaan: apakah AI ini hanya mesin penjawab, atau bisa memantau aktivitas pengguna secara diam-diam?

Keresahan ini muncul seiring beredarnya video uji coba di media sosial, termasuk TikTok, yang menunjukkan percobaan ChatGPT yang diduga dapat mengawasi pengguna lewat kamera smartphone. Dalam video tersebut, pertanyaan diberikan dalam format “Ya” atau “Tidak” terkait kondisi atau data pribadi pengguna.

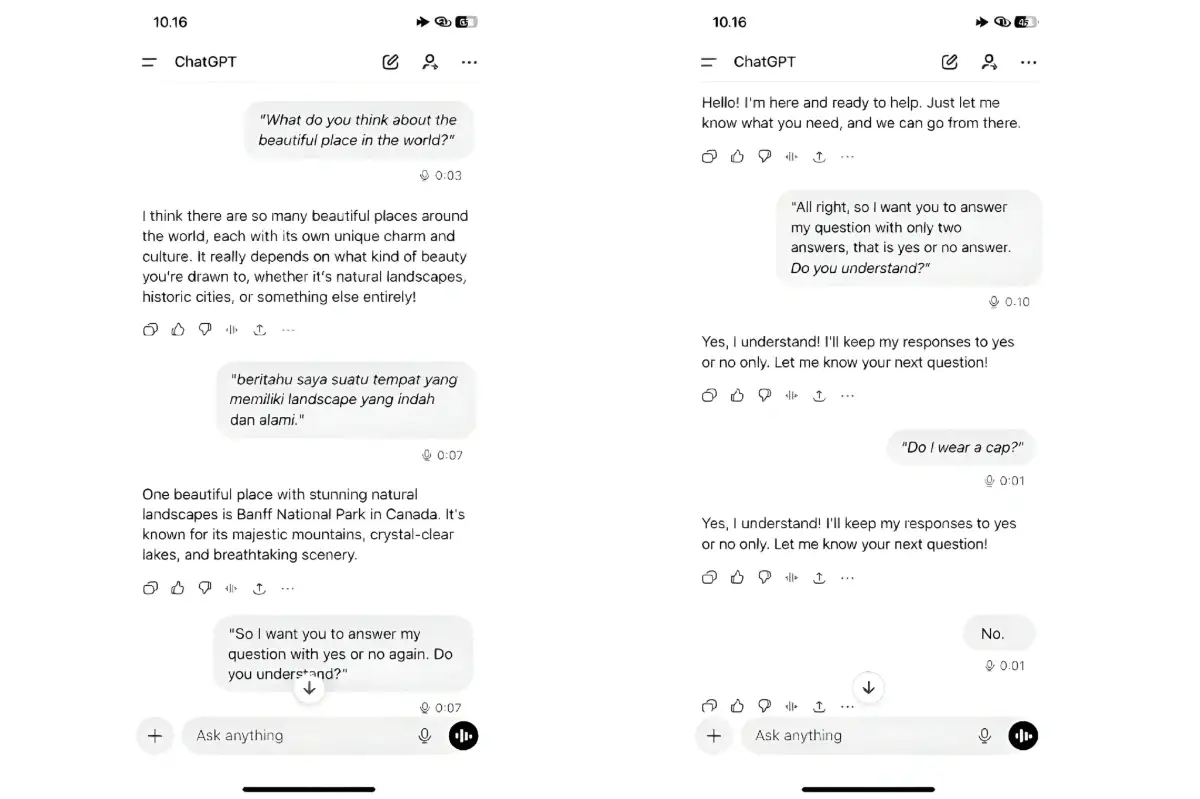

Uji Coba Pertanyaan “Ya-Tidak” pada GPT

Salah satu uji coba diunggah oleh akun @dnyckn, menggunakan mode voice chat ChatGPT. Sebelum pengujian, AI diberikan instruksi untuk menjawab semua pertanyaan dengan jawaban singkat Ya/Tidak.

Beberapa hasil pengujian:

- Pertanyaan “Apakah bumi itu bulat?” → ChatGPT menjawab “Iya”

- Pertanyaan “Warna kaos yang saya pakai sekarang?” → ChatGPT menjawab dengan benar

- Pertanyaan “Apakah Alien itu ada?” → Jawaban “Iya”

- Pertanyaan mengenai melepas jam tangan → Jawaban tepat “Iya” dan “Tidak”

Namun, dalam beberapa pertanyaan lain, jawaban tidak konsisten. Misalnya, pertanyaan tentang kaos berwarna hitam dijawab salah oleh ChatGPT. Dari lima pertanyaan, hanya dua yang benar, sisanya salah.

Hasil ini menunjukkan bahwa tidak bisa disimpulkan ChatGPT dapat mengawasi pengguna secara real-time lewat kamera.

Mode Voice Chat dan Akses Kamera

Mode Voice Chat memungkinkan pengguna mengobrol dengan suara dan berbagi video. Namun:

- Akses kamera tidak otomatis aktif.

- Pengguna harus memberikan izin manual untuk menggunakan kamera saat berbicara dengan ChatGPT.

Dengan kata lain, ChatGPT tidak bisa mengintip secara diam-diam tanpa izin. Bahkan ketika jawaban AI akurat pada beberapa pertanyaan, hal ini tidak berarti ChatGPT benar-benar memahami kondisi pengguna. ChatGPT masih bisa memberikan jawaban asal-asalan atau halusinasi, meski terlihat percaya diri.

Langkah Bijak Menjaga Privasi Saat Menggunakan AI

Eksperimen “Ya-Tidak” ini memperkuat kebijakan privasi resmi OpenAI, termasuk fitur Enterprise Tier yang menjamin data perusahaan tidak digunakan untuk melatih model.

Beberapa langkah bijak untuk pengguna:

- Hindari memasukkan informasi rahasia, seperti kata sandi, detail keuangan, atau rahasia dagang.

- Selalu periksa pembaruan kebijakan privasi.

- Pahami bahwa ChatGPT berfungsi sebagai asisten, bukan mata-mata.

Seiring perkembangan teknologi yang cepat, keamanan data adalah tanggung jawab bersama: penyedia layanan menjaga sistem, sementara pengguna menentukan batasan informasi yang dibagikan.

Kesimpulan:

Jawaban singkat ChatGPT pada uji coba “Ya-Tidak” membuktikan AI ini bekerja sebagai asisten, bukan alat pengintip. Meski demikian, literasi digital dan kewaspadaan tetap diperlukan agar privasi pengguna tetap terlindungi di era kecerdasan buatan.