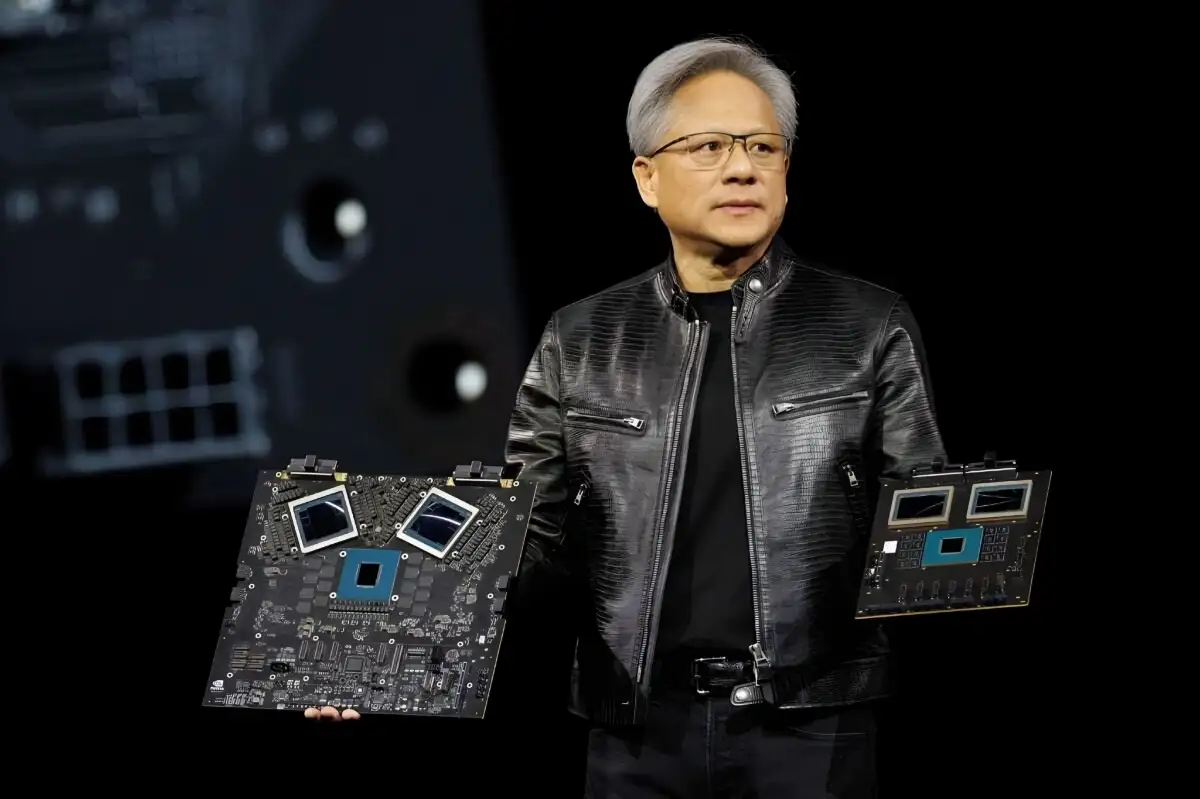

Media90 – Pada ajang Consumer Electronics Show (CES) 2026 di Las Vegas, Nvidia secara resmi meluncurkan arsitektur chip AI terbaru, Vera Rubin. Kehadiran Rubin menjadi tonggak penting dalam strategi perusahaan semikonduktor ini, sekaligus menggantikan arsitektur Blackwell, yang sebelumnya menjadi fondasi utama komputasi AI. CEO Nvidia, Jensen Huang, menyatakan bahwa Rubin dirancang untuk menangani lonjakan kebutuhan komputasi yang semakin besar, baik untuk pelatihan model AI maupun proses inferensi.

Nama “Rubin” diambil dari astronom Vera Florence Cooper Rubin, yang dikenal karena penelitian mengenai materi gelap. Pemilihan nama ini mencerminkan penghargaan Nvidia terhadap kontribusi ilmiah, sekaligus simbol ambisi perusahaan untuk memperluas teknologi komputasi.

Perubahan Strategis dari Blackwell ke Rubin

Berbeda dengan Blackwell yang lebih fokus pada GPU, Rubin hadir sebagai platform terintegrasi yang terdiri dari enam komponen utama:

-

Vera CPU

-

Rubin GPU

-

NVLink 6 Switch

-

ConnectX-9 SuperNIC

-

BlueField-4 DPU

-

Spectrum-6 Ethernet Switch

Pendekatan ini disebut “extreme codesign”, memungkinkan seluruh sistem bekerja layaknya satu superkomputer AI tunggal. Dengan bandwidth hingga 260 terabyte per detik, Rubin menjanjikan kecepatan komunikasi antarchip yang jauh lebih tinggi dibanding generasi sebelumnya.

Vera CPU: Diciptakan untuk Agentic AI

Salah satu inovasi terbesar adalah Vera CPU, CPU pertama Nvidia yang dirancang untuk agentic AI—kemampuan sistem untuk berpikir, merencanakan, dan bertindak secara mandiri dalam jangka panjang. CPU ini dibekali 88 core Olympus berbasis Armv9.2 dan konektivitas NVLink-C2C berkecepatan tinggi, memungkinkan pengolahan beragam beban kerja pusat data dengan efisiensi daya lebih baik.

Rubin GPU dan NVLink 6: Mesin Kecepatan Tinggi

Rubin GPU hadir dengan Transformer Engine generasi ketiga, mendukung kompresi adaptif berbasis perangkat keras, dan mampu mencapai performa 50 petaflops NVFP4 untuk inferensi AI.

Sementara itu, NVLink generasi keenam menghadirkan bandwidth 3,6 TB per detik per GPU, memungkinkan satu rak Rubin NVL72 mencapai 260 TB per detik. Kombinasi ini membuat Rubin sangat andal untuk beban kerja AI berskala besar.

Perlindungan Data dan Keandalan Sistem

Rubin juga menekankan keamanan dan keandalan. Nvidia menghadirkan Confidential Computing generasi ketiga untuk perlindungan data di level CPU, GPU, hingga NVLink, serta RAS Engine generasi kedua untuk pemantauan kesehatan real-time, toleransi kesalahan, dan perawatan proaktif. Sistem ini memastikan produktivitas tetap terjaga meski menghadapi gangguan teknis.

Efisiensi Energi dan Performa Maksimal

Rubin menawarkan 8 kali lebih banyak komputasi inferensi per watt dibanding Blackwell. Dengan performa pelatihan 3,5 kali lebih cepat dan inferensi 5 kali lebih cepat, Rubin tidak hanya mempercepat proses AI, tetapi juga menekan biaya operasional secara signifikan.

Ekosistem dan Adopsi Global

Nvidia menargetkan adopsi Rubin oleh penyedia cloud besar seperti AWS, Google Cloud, Microsoft Azure, dan Oracle Cloud mulai paruh kedua 2026. Selain itu, Rubin akan digunakan dalam proyek superkomputer besar, termasuk Blue Lion (HPE) dan Doudna (Lawrence Berkeley National Laboratory).

Ekosistem Rubin juga mencakup perusahaan AI ternama seperti OpenAI, Anthropic, Meta, Perplexity, hingga xAI, menegaskan posisi Rubin sebagai fondasi baru infrastruktur AI global.

Persaingan Infrastruktur AI dan Investasi Masa Depan

Peluncuran Vera Rubin hadir di tengah persaingan ketat pembangunan infrastruktur AI. Jensen Huang memperkirakan belanja infrastruktur AI global akan mencapai 3–4 triliun dolar AS dalam lima tahun ke depan, mencerminkan peran krusial AI dalam membentuk masa depan industri teknologi.

Dengan kombinasi CPU dan GPU yang dirancang khusus, bandwidth tinggi, perlindungan data tingkat lanjut, serta efisiensi energi luar biasa, Vera Rubin siap menjadi tulang punggung superkomputer AI generasi baru, menandai era baru dalam komputasi cerdas.